キーワード

- #量子技術

2022年のノーベル物理学賞は「量子もつれ」という現象を実証した3名の物理学者に贈られることになりました。最近、量子コンピューター、量子センサー、量子暗号など量子情報科学が大きな話題になっています。この背景には、これまで理論の上だけで議論されてきた量子の不思議な振る舞いが実験によって確認することができるようになり、さらに実際の社会に実装できるようになってきたことがあります。日立でもさまざまな量子技術の研究開発を行っています。今回は、日立情報通信エンジニアリングが係わっている量子コンピューター(特に量子ビット型)を例にとって話を進めていきます。

期待されていること

量子コンピューターに期待されていることは、計算処理の速さと低消費電力です。現在の古典コンピューター(「量子」に対して現代の技術などを「古典」と呼び、決して古いという意味ではありません)では実現が難しい膨大な計算量を必要とするビッグデータ処理や難問題を極短時間で計算することができるようになるからです。それでは、なぜ、量子コンピューターは、高速計算が可能になるのでしょうか?

高速計算が可能である理由

量子コンピューターの計算処理には、量子ビットを使います。量子ビットは、主に「量子の重ね合わせ」、「量子の干渉(波動性)」、「量子のもつれ」という量子特有の3つの特徴(状態)を利用します。現在、私達が使っているパソコンや富岳などのスーパーコンピューターで使われているのは、古典ビットであり0と1の二値の情報を扱います。さまざまな情報をたくさんのビット列で表現し、それらを用いて演算や制御などの処理を行っています。それに対して、量子コンピューターでは、量子ビットを使って情報処理を行います。量子ビットは、同時に0と1の二つの値を表現することができます。これは、「量子の重ね合わせ」状態を利用した量子ビット特有の表現です。この量子ビットの重ね合わせ状態は、0と1の情報が同時に「ある確率で混在」しているイメージです。ここで古典と量子でそれぞれのビットを使った計算を考えてみます。

2ビット列の古典コンピューターは、「00」「01」「10」「11」と4通りの値が得られます。3ビット列のコンピューターの場合は、同様に「000」から「111」まで8通りの値が得られます。つまりnビット列のコンピューターは、2n通りの値が得られることになります。この2n通りの情報の中から正しい1個の情報を得ようとすると、古典コンピューターでは、1回の計算処理で2n通りの内の何れか1つしか表現できないので2n回の計算を繰り返す必要があります。これに対し量子コンピューターの場合、同様にnビット列の量子ビットの重ね合わせ状態を利用することによって同時に2n個の値を全て表現することができるので、1回の計算で2n通りの処理を同時に行うことができてしまいます。

さらに量子コンピューターの計算処理は、「量子重ね合わせ」と共に「量子もつれ」を組み合わせて行います。この計算は、1回の計算処理の間で1、0の混在した重ね合わせ状態の量子ビットが、いくつも互いにもつれ合って影響を及ぼし合いながら変化して計算を実行していくことができます。

これらの操作は、「量子アルゴリズム」によって行われ、有効な答えを高確率に導き出します。この量子アルゴリズムの制御は、量子の波動性を利用した「量子の干渉」により行います。制御は量子アルゴリズムに従い、外部からマイクロ波を利用した制御信号により量子ビット間の波の干渉を起こすことで量子ビットの振動振幅を制御し、求める解を導き出します。

日立の量子コンピュータ研究

日立製作所が政府・国立研究開発法人科学技術振興機構(略称:JST)が推進する「ムーンショット型研究開発事業」に参画して進めているシリコン量子ビットを用いた量子コンピュータ研究は、量子ビットと制御回路が同一のシリコンチップ上に形成できるため、高密度で効率の良い実装を可能とします。しかし量子ビットは絶対零度に近い極低温で管理するため、マイクロ波ベースの高周波制御信号も極低温環境で動作を実現する必要があります。これらの課題を解決するためには、高度な高周波回路技術や実装技術が要求され、この要求にこたえるため、研究チームでは、スーパーコンピューター(メインフレーム)や高速大容量通信の技術開発で培ってきた高度な半導体集積回路技術や高周波回路技術をベースに新たな創意と工夫で実現させていこうとしています。

誰もが利用できるようになる将来

量子コンピューターの実用的な社会実装には、まだまだ大きな課題を抱えています。現在の古典コンピューターと同様な汎用性や使い勝手を実現するためには、量子ビットの大規模化や雑音によるエラー対策などの課題解決が必須です。しかし、我々技術者は、現在の古典コンピューターの進化においても同様な大きな課題をいくつも乗り越えて現代の情報社会を構築してきました。量子コンピューターも近い将来、クラウド上で誰でも利用できるようになり、古典コンピューターとのコラボレーションすることによる情報科学分野の革新的な進化が始まろうとしています。

付録:量子コンピューターの課題

量子は、観測(計測)されるまでは波の性質(波動性)であり、観測と同時に粒子の性質(粒子性)にかわります。量子コンピューターの計算中は、量子ビットを計測することなく波動性を保ったまま計算処理を行います。このため量子ビットの制御は、量子の波動性を利用した波(振動)の干渉によって制御をおこないます。最終的な計算結果を出力する時には、観測を行います。観測結果は粒子性の結果として、0か1のどちらか一方に決定されます。(観測された後は、量子性は失われ、確定的な古典状態になります)

量子ビットの計算中は、量子状態(「量子重ね合わせ状態」「量子もつれ状態」)を保つことが必要です。

ただし、この量子状態は、周囲のストレス(環境変化や雑音等)に非常に敏感で、安定に保つことは難しく、量子状態の時間は極めて短くなります(最長時間でもμsecオーダー)。計算は、この時間内で終わらせる必要があります。この量子状態を長時間保つことが課題となります。

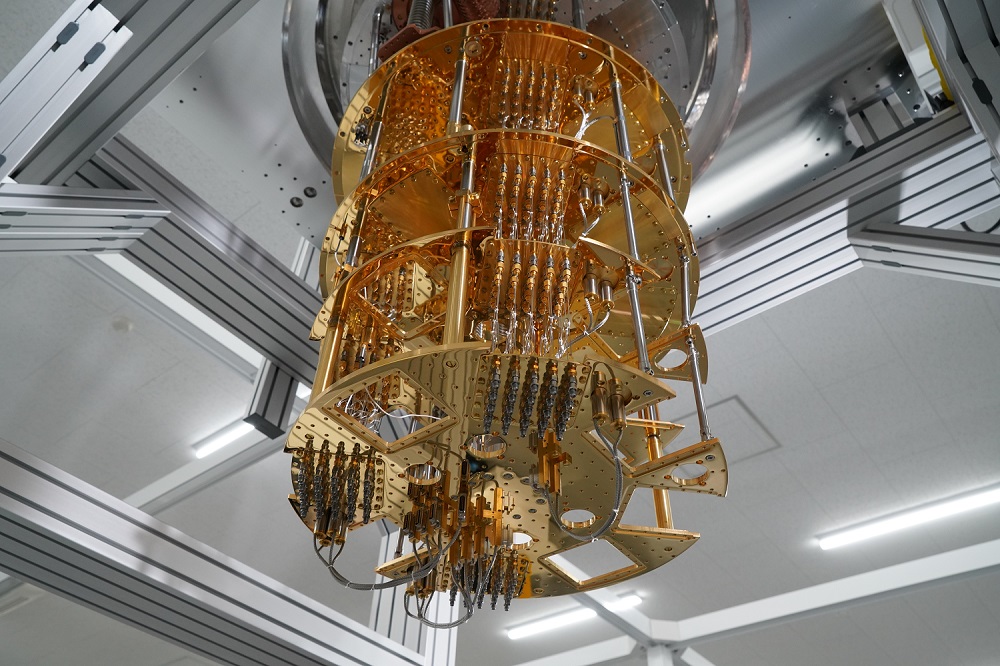

また、量子状態を保つためには、量子ビットを数mK(ミリケルビン)以下の極低温の環境に保つ必要があります。このため、現在の量子コンピューターは、計算効率をいくら上げても極低温環境を構築する冷蔵処理で膨大なエネルギーが必要となるため、量子ビットの高温での安定化と冷蔵技術の低消費電力化を実現することが大きな課題です。

ジョセフソン結合素子を使う超電導量子ビット型の量子コンピューターは、シリコン量子型と同様に量子ビットを形成する量子デバイスを極低温で冷やしますが、その量子ビットの制御信号は、室温環境で構築された制御回路から同軸ケーブルで極低温環境の量子デバイスに供給します。1量子ビットの素子には、複数の信号が必要なため、1量子ビット当たり数本の高周波ケーブルにより供給されます。量子ビットが増大するとケーブルの本数も数倍で増えていくため、実装が複雑になり、雑音などの影響でエラーが生じやすくなります。このような雑音によるエラーは、量子ビットを誤動作させるためエラー訂正が必要になります。

また、現在実現されている量子ビット型の量子コンピューターは、最大でも100ビット程度の規模ですが、実用的な計算をさせるために最低でも100万ビット程度が必要になります。量子コンピューターはビット数を増やすと指数的に計算能力が向上しますが、同時に雑音の影響を受けやすくなりエラーが生じやすくなります。このエラー訂正を行うために現状では、1ビットあたり9ビット程度のエラー訂正用(計算用とは別)の量子ビットが必要になります。このため量子コンピューターは上記の様な膨大なビット数が必要になります。このエラー訂正における課題に対して、さまざまな取組みが行われています。最新の情報では、9ビット必要とされていた誤り訂正用の量子ビットが3ビット程度で実現できるようになってきました。

また日立が開発を進めるシリコン量子ビット型の量子コンピューターは、制御回路と量子ビットが同じシリコンチップ上に共存実装できるため複雑なケーブルは必要なくなり、大容量のデバイスの集積化と低雑音化が期待できます。 ただし、制御回路は量子デバイスと共に極低温環境で動作させる必要があり、電子回路設計、実装設計が大きな課題となります。

2022年11月

株式会社 日立情報通信エンジニアリング

経営戦略本部 主管技師長 原澤 克嘉

関連リンク

※編集・執筆当時の記事のため、現在の情報と異なる場合があります。編集・執筆の時期については、記事末尾をご覧ください。